MATLAB’DE VERİ TEMİZLEME VE ÖN İŞLEME YAPMAK

Bir modelin başarısı çoğu zaman algoritmadan değil, veriden gelir. Eksik değerler, tutarsız birimler, yanlış tipler ve aykırı gözlemler; en iyi yöntemi bile yanıltabilir. Bu yüzden MATLAB’de veri temizleme ve ön işleme, analitiğin “gizli hızlandırıcısı”dır: hem doğruluğu artırır hem de üretim süreçlerini daha öngörülebilir hale getirir.

Bu makalede, MATLAB veri temizleme yaklaşımını kurumsal senaryolara uygun şekilde ele alacağız: veri profillemek, eksikleri yönetmek, aykırı gözlemleri yakalamak, ölçeklemek, kategorik değişkenleri düzenlemek ve pipeline’ı tekrar çalıştırılabilir hale getirmek. Hedef; tek seferlik müdahaleler değil, standartlaşmış bir ön işleme akışı kurmaktır.

Kurumsal ekiplerde veri ön işleme yalnızca istatistik işi değildir; veri sözlüğü, sürümleme, izlenebilirlik ve kalite kapılarıyla birleştiğinde, karar vericilerin güvenini artıran bir üretim disiplinine dönüşür.

MATLAB veri temizleme hedefini belirlemek

Primary ve secondary keyword kümelerini doğal kurgulamak

Birincil odak başlıktan türeyen “MATLAB veri temizleme” olacaktır. Metin içinde doğal biçimde şu secondary kümeleri dağıtın: veri ön işleme, eksik değer yönetimi, aykırı gözlem tespiti, ölçekleme standardizasyonu, kategorik veri düzenleme, veri profilleme, feature engineering hazırlığı, veri doğrulama kuralları, tekrar çalıştırılabilir pipeline, modelleme öncesi hazırlık. Bu kümeler, başlıkların içerikle uyumlu kalmasını sağlar.

Analiz amacını ve kabul kriterlerini yazılı hale getirmek

Temizleme adımlarını rastgele seçmek, veri kaybına veya önyargıya yol açabilir. Önce hedefi tanımlayın: sınıflandırma mı, regresyon mu, zaman serisi tahmini mi? Ardından kabul kriterlerini belirleyin: maksimum eksik oranı, aykırı değer toleransı, birim standartları, veri tipi kuralları. Bu kriterler, kurumsal ekiplerde “neden böyle yaptık?” sorusuna net yanıt verir.

Veri sözlüğü ve tip disiplinini başlatmak

Matlab tablolarında (table, timetable) kolon tipleri karıştığında hatalar gizlenir. Örneğin sayısal olması gereken bir kolon, string kalır ve hesaplar yanlış sonuç üretir. Bu nedenle veri sözlüğü oluşturmak; kolon adı, tipi, birimi ve beklenen aralık gibi kuralları tanımlamak, ön işlemenin en önemli adımlarından biridir.

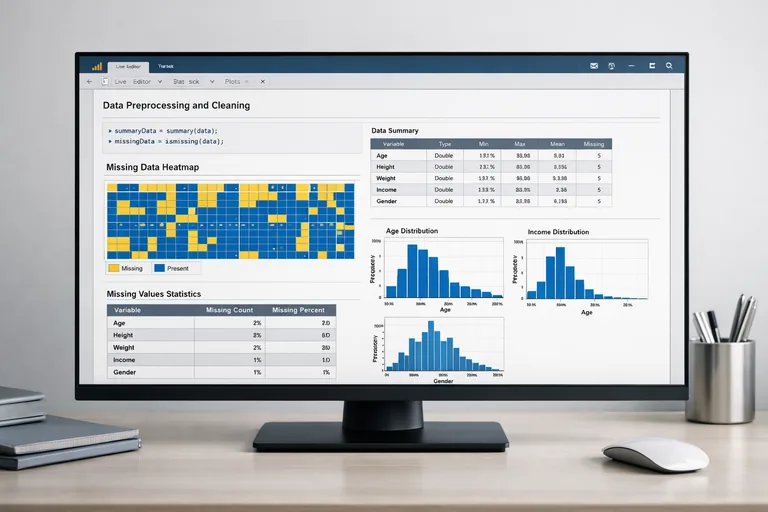

Veri profillemek ve kaliteyi ölçmek

Özet istatistiklerle hızlı sağlık kontrolü yapmak

Temizliğe başlamadan önce veri dağılımını görün. Minimum, maksimum, ortalama, medyan, standart sapma gibi özetler; ölçüm hatalarını ve uç değerleri hızla ortaya çıkarır. Ayrıca benzersiz değer sayısı, kategorik kolonlarda tutarsız etiketleri yakalamaya yardımcı olur. Amaç; problemi sezmek değil, ölçerek görmek olmalıdır.

Eksik değer haritası ile riskli kolonları belirlemek

Eksik değerler her zaman aynı önemde değildir. Kritik hedef değişkeni veya ana özelliklerdeki eksik, modeli bozabilir; ikincil kolonlarda ise daha esnek davranılabilir. MATLAB’de missing değerleri oranlayıp kolon bazında raporlamak, hangi alanlarda veri toplama sürecinin iyileştirilmesi gerektiğini de gösterir.

Yinelenen kayıt ve anahtar tutarlılığını doğrulamak

Kurumsal veride en sık sorunlardan biri duplicate kayıtlardır. Aynı müşteri, aynı sensör ölçümü veya aynı işlem birden fazla kez yazılmış olabilir. Anahtar alanları (ID, timestamp, deviceId) üzerinden yinelenenleri yakalayıp karar vermek gerekir: birleştirmek mi, birini atmak mı, yoksa kaynağa geri dönüp düzeltmek mi? Bu karar, iş mantığıyla birlikte alınmalıdır.

Eksik değer yönetimini sistemli hale getirmek

Silmek, doldurmak ve işaretlemek seçeneklerini değerlendirmek

Eksik değerle üç temel yaklaşım vardır: satırı/kolonu silmek, istatistiksel olarak doldurmak (impute etmek) veya eksikliği ayrı bir sinyal olarak işaretlemek. Hangi yaklaşımın doğru olduğu, eksik mekanizmasına bağlıdır. Örneğin sensör kesintisi rastgele değilse, “doldurmak” hatayı gizleyebilir. Bu yüzden eksik değer yönetimini tek bir kural yerine senaryoya göre seçmek gerekir.

Sayısal ve kategorik kolonlarda farklı strateji uygulamak

Sayısal kolonlarda ortalama/medyan ile doldurma yaygındır; ancak dağılım çarpıksa medyan daha güvenli olur. Kategorik kolonlarda ise en sık görülen sınıf veya “Unknown” gibi bir etiket seçeneği düşünülebilir. Burada kritik olan, modelin eksikliği yanlış bir sınıf gibi öğrenmesini engellemektir.

Zaman serilerinde akıllı doldurma yapmak

Timetable verilerinde eksik değerler, örnekleme boşluklarından kaynaklanabilir. Bu tür verilerde lineer interpolasyon, önceki değerle doldurma veya hareketli ortalama gibi yöntemler daha anlamlı olabilir. Ancak bu yöntemler, geleceğe bilgi sızdırmamalıdır; eğitim ve test ayrımında dikkatli uygulanmalıdır.

Aykırı gözlem tespiti ve robust yaklaşım geliştirmek

IQR ve z-score gibi basit eşikler kurmak

Aykırı gözlemler, ölçüm hatası da olabilir, gerçek bir olay da. Bu yüzden önce basit eşiklerle adayları bulun: IQR (çeyrekler açıklığı) veya z-score ile uç noktaları işaretleyin. Ardından iş mantığıyla birlikte değerlendirin. Örneğin üretim hattında ani sıcaklık artışı gerçek bir arıza sinyali olabilir; bu veriyi silmek, en değerli bilgiyi yok eder.

Robust istatistiklerle etkisini azaltmak

Her aykırı değeri silmek yerine, robust ölçekleme ve robust modellerle etkisini azaltmak mümkündür. Medyan ve MAD (median absolute deviation) gibi ölçüler, uç değerlerin etkisini düşürür. Böylece veri korunur, fakat model daha stabil davranır.

Aykırı değerleri “etiketleyerek” izlenebilir kılmak

Kurumsal ortamlarda en iyi pratik, aykırı değerleri tamamen yok etmek yerine etiketlemektir. Böylece downstream ekipler (kalite, operasyon, ürün) bu kayıtları inceleyebilir. Ayrıca pipeline içinde aykırı değer oranını KPI olarak izlemek, veri kalitesini zaman içinde iyileştirmeye yardımcı olur.

Ölçekleme, dönüşüm ve özellik hazırlığı yapmak

Standardizasyon ve normalizasyon kararını vermek

Ölçekleme, özellikle mesafe tabanlı algoritmalar ve düzenlileştirme kullanan modellerde kritik olur. Standardizasyon (ortalama 0, std 1) genellikle güvenli bir varsayılandır; normalizasyon (0–1) ise sınırlı aralık isteyen yöntemlerde tercih edilir. Kararı, model ailesine göre vermek gerekir; “her yerde aynı” yaklaşım yerine, hedefe uygun ölçekleme seçmek daha sağlıklıdır.

Log dönüşümü ve dağılım düzeltmesi uygulamak

Dağılımı aşırı çarpık olan değişkenlerde log dönüşümü, modeli daha lineer hale getirebilir. Ancak sıfır ve negatif değerlerde dikkat gerekir; küçük bir offset eklemek gibi pratikler kullanılabilir. Bu dönüşümler, açıklanabilirlik açısından da dokümante edilmelidir.

Kategorik değişkenleri tutarlı kodlamak

String etiketleri doğrudan kullanmak yerine, categorical tipe çevirmek ve tutarlı sınıf seti tanımlamak önemlidir. Eğitim ve testte farklı etiket setleri oluşursa, model üretimde hata verir. Bu yüzden kategorik seviyeleri “sözlük” gibi sabitlemek, kurumsal teslimlerde güven sağlar.

Tekrar çalıştırılabilir pipeline kurmak

MATLAB koduyla eksik ve aykırı yönetimini paketlemek

Aynı temizliği her yeni veri geldiğinde elle yapmak, sürdürülemez. Aşağıdaki örnek, bir table üzerinde eksik değerleri raporlayıp sayısal kolonlarda medyan ile doldurmaya yönelik gerçekçi bir başlangıçtır. Bu fonksiyon, kurumsal projede loglama ve kural tabanı ile genişletilebilir.

% MATLAB: basic missing value profiling and imputation (table)

function [Tclean, report] = clean_missing(T)

report = struct();

vars = T.Properties.VariableNames;

missRate = zeros(numel(vars),1);

for i = 1:numel(vars)

v = T.(vars{i});

missRate(i) = mean(ismissing(v));

end

report.missingRate = table(vars', missRate, 'VariableNames', {'Variable','MissingRate'});

Tclean = T;

for i = 1:numel(vars)

v = Tclean.(vars{i});

if isnumeric(v)

m = median(v, 'omitnan');

v(ismissing(v)) = m;

Tclean.(vars{i}) = v;

elseif iscategorical(v)

v(ismissing(v)) = categorical("Unknown");

Tclean.(vars{i}) = v;

end

end

end

Ölçekleme ve eğitim-test sızıntısını engellemek

Ölçekleme parametrelerini (ortalama, standart sapma) tüm veri üzerinde hesaplamak, test setine bilgi sızdırır. Doğru yaklaşım; parametreleri yalnızca eğitim setinde öğrenip test/üretim verisine uygulamaktır. Aşağıdaki örnek, eğitimden öğrenilen parametreleri saklayıp yeni veriye uygulayan basit bir şablondur.

% MATLAB: fit scaling on train, apply to new data

function [Xn, scaler] = fit_standardize(X)

scaler.mu = mean(X, 1, 'omitnan');

scaler.sigma = std(X, 0, 1, 'omitnan');

scaler.sigma(scaler.sigma == 0) = 1;

Xn = (X - scaler.mu) ./ scaler.sigma;

end

function Xn = apply_standardize(X, scaler)

Xn = (X - scaler.mu) ./ scaler.sigma;

end

İç eğitim kaynağıyla ortak yaklaşımı yaymak

Veri temizleme ve ön işleme, ekip içinde ortak standart olmadan sürdürülemez. Yeni gelen verilerde aynı kuralların çalışması için eğitim, örnek kod ve dokümantasyon tek yerde toplanmalıdır. Bu amaçla MATLAB eğitimi sayfası üzerinden table/timetable, missing yönetimi ve feature hazırlığı konularını yapılandırılmış şekilde ilerletebilirsiniz. Böylece veri doğrulama kuralları ve tekrar çalıştırılabilir pipeline ekip standardına dönüşür.

Özetle, MATLAB’de veri temizleme ve ön işleme yapmak; veriyi profillemek, eksikleri senaryoya göre yönetmek, aykırı gözlemleri etikete bağlamak, ölçekleme ve dönüşümleri kontrollü uygulamak ve tüm adımları tekrar çalıştırılabilir bir pipeline’a dönüştürmekle mümkün olur. Bu disiplin, kurumsal karar süreçlerinde güvenilirliği artırır ve model performansını stabilize eder.